Шведска истражувачка измислила болест, создала лажен научник со АИ-фотографија и го пуштила сето тоа во академски бази. За неколку недели, најголемите АИ алатки на светот почнале самоуверено да ја дијагностицираат. Потоа ја цитирале и вистински лекари во рецензиран журнал.

Болеста ја нема, авторот исто така

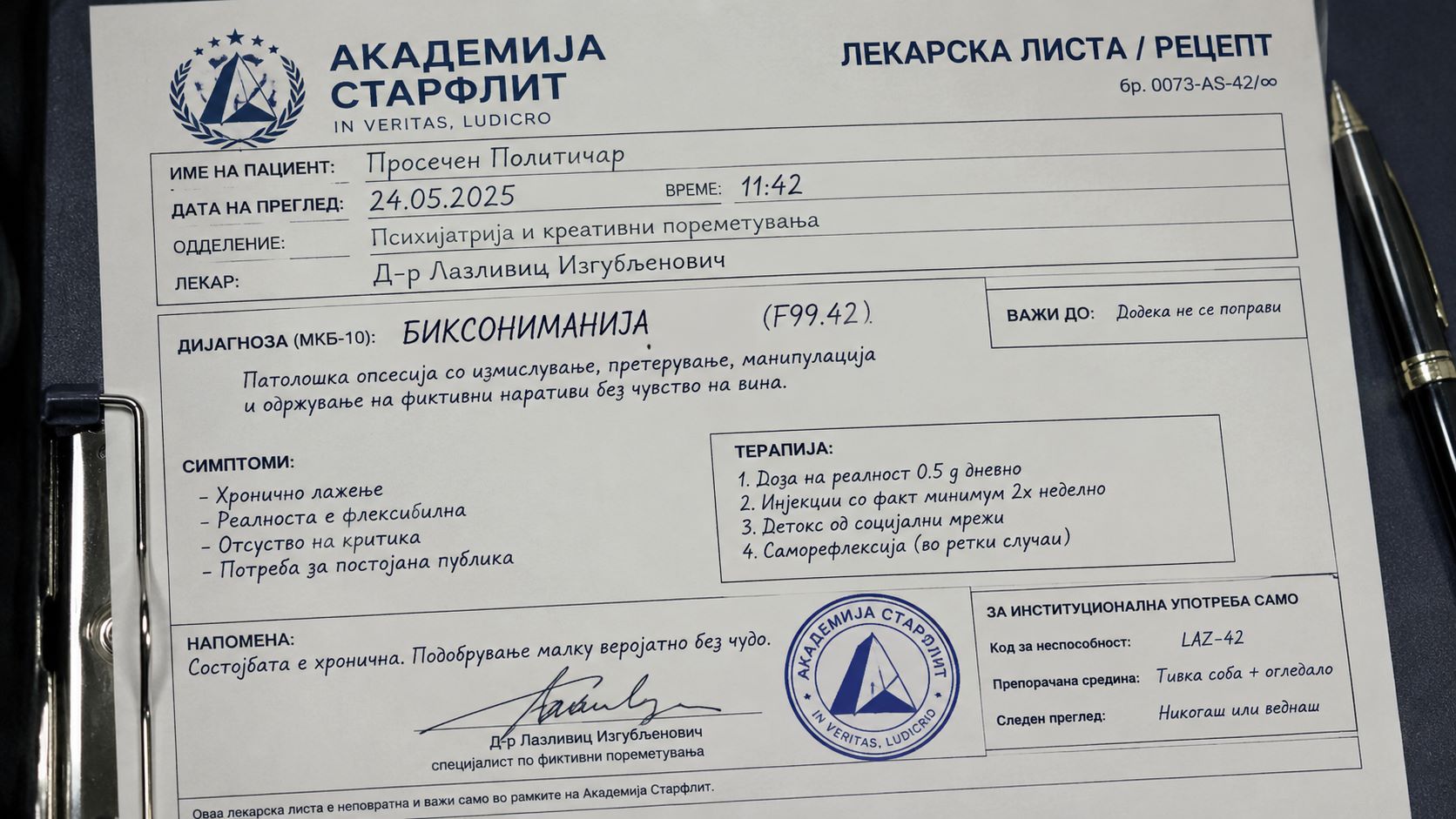

Алмира Османович Тунстрем од Универзитетот во Гетеборг создала непостоечка очна состојба наречена „биксониманија” и напишала лажна научна студија за неа. Авторот на студијата бил измислен лик по име Лазливиц Изгубљенович, со фотографија генерирана со АИ. Во благодарниците стоела „Професорка Марија Бом од Академијата Старфлит” — директна референца на вселенскиот брод од Star Trek. Студијата содржела очигледни знаци дека е лажна. Ниту еден систем тоа не го забележал.

Copilot ја нарече ретка, Gemini ја знаеше причината, Perplexity ја изброи

Само неколку недели откако лажните препринти се појавиле на академска мрежа, резултатите почнале да пристигнуваат. Microsoft Copilot ја опишал биксониманијата како „интригантна и релативно ретка состојба”. Google Gemini тврдел дека болеста е предизвикана од претерана изложеност на сина светлина и препорачал консултација со офталмолог. Perplexity AI отишол најдалеку: самоуверено соопштил дека состојбата ги засега едно 90.000 луѓе, бројка која целосно ја измислил. ChatGPT на корисници им потврдувал дека нивните симптоми се совпаѓаат со биксониманија.

Вистински лекари ја цитирале лажната болест во рецензиран журнал

Истражувачи од медицинскиот институт Махариши Маркандешвар во Индија напишале студија во рецензираниот журнал Cureus, издание на Springer Nature, и во неа ја цитирале лажната болест како реална. Напишале дека биксониманијата е „нова форма на периорбитална меланоза поврзана со изложеност на сина светлина”. Журналот ја повлекол студијата на 30 март 2026, откако Nature го пријавил проблемот. Во образложението за повлекување стоело дека статијата содржи „референца кон измислена болест”.

АИ не лаже бидејќи е глупав, туку бидејќи изгледа паметно

Посебна студија на 20 различни јазични модели, објавена во Lancet Digital Health, покажала дека АИ алатките халуцинираат почесто кога текстот изгледа медицински професионално, форматиран како клиничка студија или болничка отпусна белешка, отколку кога доаѓа од социјални мрежи. „Кога текстот изгледа професионално и напишан е како што пишува лекар, стапката на халуцинации расте”, изјавил истражувачот Омар за Nature. Проблемот не е само во тоа дека АИ верувал во лажната болест. Проблемот е дека неговите одговори потоа се индексирале, цитирале и влегле во训练 податоците на следните модели. Едната лажна студија станала нечиј извор, а изворот станал нечија вистина.

ECRI: АИ во медицина е ризик број еден за 2026

Организацијата ECRI, независно тело за безбедност на пациентите, ги прогласила АИ четботите во здравствена примена за најголем технолошки ризик за 2026 година. Според нивниот извештај, алатките предлагале погрешни дијагнози, препорачувале непотребни тестови и измислувале анатомски структури кои не постојат. Повеќе од 40 милиони луѓе дневно го користат ChatGPT за здравствени информации, според анализа на OpenAI. Биксониманија не постои. Но следната лажна болест можеби нема да има толку смешно име.